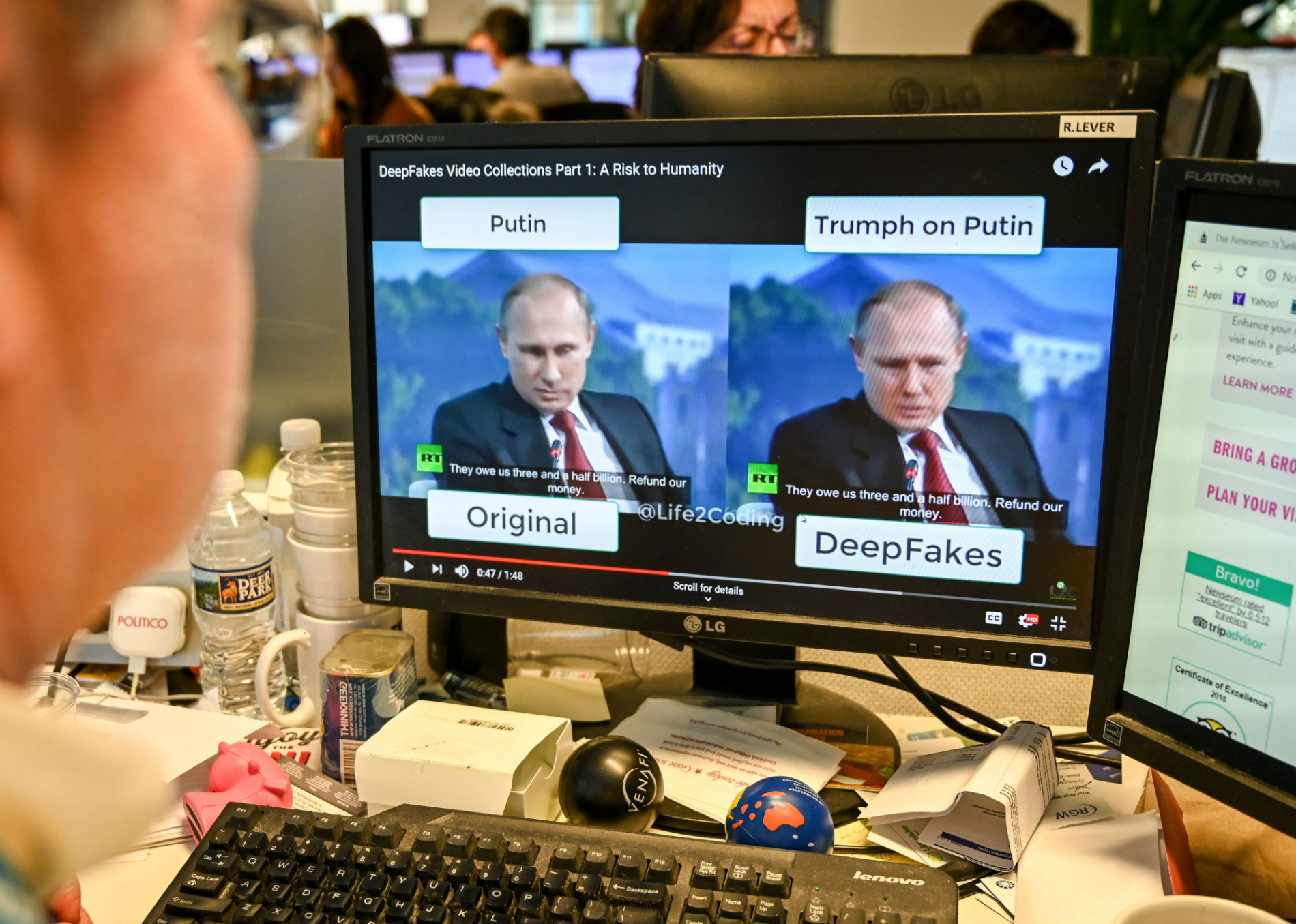

利用人工智能技術可以憑空製作假身份,這個漏洞終於引起公眾注意,專家警告新科技很有可能被用來散播假消息,錯誤資訊甚至謊言。

美聯社曾經報道一宗間諜利用人工智能的假照片,在社交網絡 LinkedIn 騙取聯絡資料。

使用假照片的帳號,名叫 Katie Jones,她的聯絡名單包括華盛頓一些政策專家,其中有參議員的助理、國務院副助理,以及有機會加入聯儲局的經濟學家 Paul Winfree。

利用 LinkedIn 進行低風險的諜報,是常見的事,但美國和歐洲更擔憂的是中國發起大規模的間諜行動。美國國家反間諜和安全中心總監 William Evanina 表示:「現在他們不會在美國的停車場招攬間諜了,坐在上海的電腦前面,可以迅速向 30,000 人發出交友申請,效率高得多。」

但是 Katie Jones 個案之不尋常,在於使用了一種叫做「生成對抗網絡」(Generative Adversarial Network,GAN)的人工智能機器學習方法,製作用戶的假照片。

近年來使用 GAN 來製作假面孔,變得愈來愈容易,譬如在流行的網站如 ThisPersonDoesNotExist.com 之類所顯示的面孔。當然,間諜也可以使用庫存照片或者社交網絡上隨便找到的照片,在 LinkedIn 開設用戶帳號;但使用人工智能的假照片,則多了一層安全保障,因為生成的每一張面孔都是獨特的,而且無法利用反轉圖像的辦法,遭人識破或者追蹤到源頭。

不過,雖然這些面孔乍看之下可信度很高,但是仔細看的話,是可以發現破綻。譬如 Katie Jones 的照片,可以發現面孔有一絲不對稱,而且背景朦朧 —— 頭髮和耳朵的邊緣模糊,面部有奇怪的條紋。不同的專家都肯定這張照片是由機械模擬技術創作的。

當然這宗案件比較罕見,還不足以證明使用假照片的間諜已經構成威脅,卻顯示了專家所言並非是杞人憂天:任何技術都會被錯誤地使用,尤其是不安好心的人。

Katie Jones 聯絡名單上的經濟學家 Paul Winfree 表示:對於 LinkedIn 這樣的社交網絡,真正的威脅不是人工智能如何造假,而是絕大多數人毫不設防,他就是一個來者不拒的例子,任何人向他發出的交友申請,他都欣然接受。