當我們憂慮自己快將被 AI 取代,人類也舉行了首場「AI 安全峰會」(AI Safety Summit),28 國聯署「布萊奇利宣言」(Bletchley Declaration)承諾共同應對威脅。究竟這場將會寫入史書的會議,得出了甚麼結論?各國元首又為未來許下甚麼承諾?

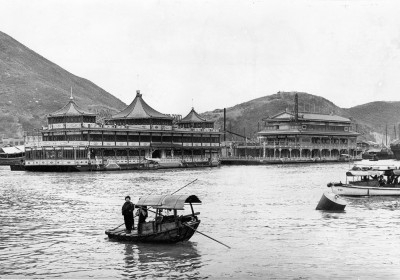

峰會目的是為了推進各國代表、商業領袖與科技專家對話,以深入探討 AI 潛在風險,制定出避免 AI 引發災難的未來藍圖。會議於 11 月 1 日至 2 日舉行,地點是英國布萊切利園(Bletchley Park),也就是第二次世界大戰期間,英國對軸心國文件進行密碼解讀的主要地方,電腦之父圖靈(Alan Turing)也是在當地進行恩尼格瑪密碼機(Enigma)解密工作,因此峰會選址可謂別具意義。

不過英國首相辛偉誠(Rishi Sunak)的立場曖昧,呼籲人類不應對 AI 產生過度恐慌,但同一時間又警告 AI 潛在的危險程度與核戰無異。與會的馬斯克(Elon Musk)一言不發,但他在場外發表意見,認為當前人類面對史無前例的威脅,又認為科技公司應該設定「裁判員」(referee)職位,以規範 AI 開發與應用,但必須要相當謹慎。

峰會最大成果無疑是 28 個國家共同簽署的「布萊奇利宣言」,其中包括中國、美國和歐盟,針對最新 AI 應用技術的潛在風險提出解決方案,所針對的正是以 ChatGPT 為首的大型語言模型,宣言警告不論故意抑或無意,這種 AI 模型都有條件帶來災難後果。雖然英國政府表揚有關宣言為人類創先河,但國際評論對會議整體成果褒貶不一,又認為宣言僅肯定 AI 的潛在風險,承諾要再作探討,除了計劃未來舉辦多場峰會,目前仍沒有任何具體措施。

英國能領導 AI 產業嗎?

牛津大學著名 AI 倫理學學家 Carissa Véliz 接受國際科普雜誌 New Scientist 訪問時批評,宣言欠缺應對問題的決心,「鑑於 AI 風險之高、開發與應用之快速,僅僅計劃在未來召開另一場峰會,實在是不夠大膽」。研究組織「可信人工智能發展中心」(CATAI)成員 Gary Marcus 對宣言表示歡迎,但同樣呼籲與會國應當有更具體的行動方案。

AI 應用研究公司 AMPLYFI 行政總裁 Paul Teather 接受 Euronews 訪問時認為,主要大國就道德原則達成共識是可喜,但人類實在有必要迅速制定具體的政策和問責機制,僅依靠自願的合作並沒有任何保證。

眾所周知,辛偉誠期望使英國成為 AI 產業領袖,英國已經宣佈投資 2.25 億英鎊,開發名為 Isambard-AI 的新 AI 超級電腦,運算速度將比英國目前最快的電腦高出 10 倍;另一台英國超級電腦 Dawn 也正在開發中,可望在融合能源、醫療保健和氣候模擬等多重領域取得突破。兩台電腦都計劃在明年夏天投入應用。

不過,目前仍不清楚英國打算如何監管 AI,反而其他國家已經開始制定自身政策,美國、中國和歐盟都為此展開激烈競爭。美國總統拜登在 10 月 30 日簽署 AI 行政命令,歐盟也努力制定有關 AI 指導原則,英國則表明不打算進行新立法工作,僅計劃讓現有監管機構負責各自部門的 AI 監管。假如英國要領導人類應對 AI 危機,辛偉誠似乎要在國內外加把勁。