在 AlphaGo 與李世石的首戰前夕,主導其開發計劃的 Google 副總裁 Demis Hassabis 還以為李世石有一半機會勝出,結果 AlphaGo 表現比 Hassabis 想像還要出色,正正顯示了開發者也不一定全面掌握人工智能的進程。雖然 Hassabis 和人工智能的專家喜出望外,但卻引起愈來愈多的人擔心人類甚麼時候會被取代、人工智能會否毀滅人類?

即使是 Hassabis 也不敢否認如果人工智能落入變態科學家和政客手上,會帶來壞影響,但機器威脅人類安全的日子尚遠,目前人工智能甚至不能掌握「德州撲克」一類多玩家、資料不公開的遊戲,他認為公眾的恐懼淡化了人工智能帶來的好處,例如上次提及的「知識福袋」,除了讓人快速獲得知識,亦可以幫助腦退化症患者重拾記憶。

事實上,AlphaGo 與李世石的對奕並非機器向人類下的戰書,而是人工智能的一場考試。接下來,人工智能的進程應該是加入意識和價值系統,令機器變得更有價值,例如我之前談及即時翻譯的科技瓶頸,其實是有可能由人工智能去突破。又或者想像一下在災難現場,智能機械人可以不惜損壞自己的機件拯救傷者,但如果它計算到拯救傷者甲會嚴重損壞它的部件,令它不能拯救餘下五十個傷者,它會否先拯救另外的傷者,甚至放棄傷者甲?這便牽涉到自我意識和價值系統的應用。

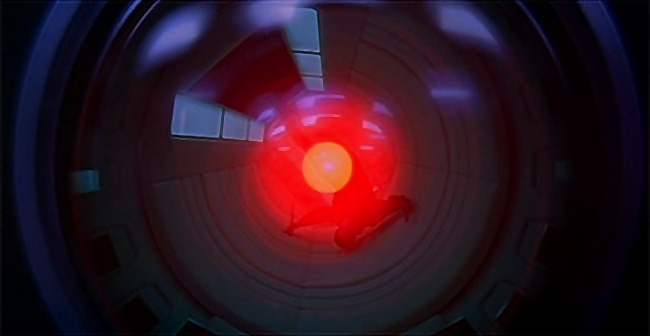

大家所擔心人工智能叛變進而毀滅人類,這是讓機器懂得意識和價值系統之後的事。例如 2001 太空漫遊的 HAL 電腦,就是覺得人類要斷它的電源而先下手為強,這涉及對自身存在的關心,以及被隊友背叛的哀傷感受。但要發展意識和價值系統,首先的問題是「甚麼是意識」及「意識是如何運作」,這已經很難有一個標準答案。

物理學家 Michio Kaku 嘗試用科學模型去拆解意識,他把意識分為三個級別:空間、社交、策略。有很多人批評他把意識過於簡化,身為理論物理學家卻隔行挑戰對心理學指手劃腳,但無可否認他的模型是社會大眾認識意識很好的起步點。如果用他的定義,AlphaGo 擁有空間和部份策略級別的意識,但沒有社交意識,亦因而不懂得社交相關的策略;HAL 電腦則有社交意識,所以會有被背叛的體驗,也懂得長期策略(在太空執行任務)和社交策略(放棄背叛的人從而保護自己)。

這裡可以衍生一些問題:

問題一:

我知道有意識的機械人對人類有很大的效益,但如果科學家都不能百分百肯定人類的安全,為何不能繼續集中發展有智能無意識的機械人?

我們必須弄清楚一件事:即使機器沒有意識,被壞人利用也會對人類構成傷害;當機器有了意識,亦不必然要毀滅人類。因此,如果我們為了防止最極端的情況,而避免發展人工智能去改善甚至拯救已被人類破壞得七七八八的地球,並不值得。

續問

人工智能的誤用會帶來甚麼傷害?

很多政客或官員都對人工智能很有興趣,他們想研發更強更具作戰意識的機械人,簡單來說就是研究殺人機器,這些真的是用來毀滅人類。不過,在到達這天之前,他們已經可以做其他壞事。

舉例說我們開始習慣使用的 Google 以圖搜圖,當中需要人工智能去辨認圖像的內容,不難想像人工智能在了解圖像這方面的技術已相當成熟。如果政府在不同的地方安裝閉路電視,並用人工智能分析你每天做的事情,如果發現有不尋常的行為便通知執法機關,便立即呈現了「1984」的場景了。

問題二:

科學家說發展有意識的機械人並不容易,但是否真的尚有漫漫長路?

「不幸地」,雖然我們不能理解意識,但有科學家已開始模仿意識的機械人實驗,並成功通過自我意識測試:

這個測試有三個機械人,分別服用了三粒藥丸(特別設定),其中兩個機械人會被滅聲和癱瘓,然後研究員問誰人沒有吃有問題的藥丸?成功通過測試的機械人先回答「不知道」,接下來發現自己是沒有吃的那位幸運兒。這個測試背後涉及很多的智能開發,包括明白研究員的問題,辨認由自己發出的聲音,再連結之前的問題,然後判斷。

儘管這些機械人看似成功通過意識模仿的測試,科學家是特意為這個測試而開發它們,要真正發展意識去適應瞬息萬變的現實世界,確實有漫漫長路。

問題三:

人工智能的發展比科學家預期更快,那科學家常掛在咀邊「不用擔心,機器會威脅人類的日子還遠」,到底是否變態科學家佈下的騙局?

我比較傾向科學家發展科技是出於好意,誤用科技的通常是政客。當然,很多科技名人和科學家都表達了對人工智能的擔心,但他們會嘗試去消除擔心,而不是只抱怨不做事,例如男神 Elon Musk 甚至投資巨額成立 Open AI 計劃,提倡開放人工智能源碼讓大部份人可以掌握技術,同時互相提防有人利用人工智能做壞事。Hassabi 的 DeepMind 也有一個道德委員會,由頂尖的哲學家及科學家組成,嘗試訂立人工智能應用的規則及討論將來注入價值判斷的時候,怎樣達成造福世界的目標,而避免災難性的後果。

有人說,人類科學發展到達了另一個瓶頸,最新的理論並非人類可以證明的層次,已經是哲學問題;太空探索更是人類有涯生命不能完成的事。於是,科學家希望善用人工智能探索太空,機械人不需要糧食,不用回到地球,它們可以用比人強的分析尋找適合生命的星球。這樣便不用解決 Interstellar (星際啟示錄)拯救哪一個太空勇士的窘境,也不會登陸錯誤的星球,浪費了數十年的時間。大家都說外星文明來到地球必然是比我們更有智彗,有時候我會想外星人應該都是有人工智能的機械人,又或者我們是某外星文明的智能機械人,有情感、意識,以及深度學習和繁衍的能力,終於進化到要發展新一代的人工智能,繼續探索浩瀚無垠的宇宙。